A negatív kampány új fegyvere fenyegeti a választások tisztaságát

Most még csak a közösségi médiát hódította meg a viccesnek tűnő lehetőség, azonban a szórakoztató külső sötét technológiai fegyvert rejt.

A deepfake technológia terjedésével szinte minden számítógéppel rendelkező, átalgos felhasználó képessé vált arra, hogy egy képet, de leginkább videót a maga ízlése szerint manipuláljon. A deepfake szó a deep learning és a fake angol kifejezések keveredéséből alakult ki; előbbi a mesterséges intelligencia tanulási folyamatát, míg utóbbi a hamisat jelenti. Maga a kifejezés 2017-ben tűnt fel először az interneten, azóta egyre ismertebb.

Használatához nincs szükség komoly számítástechnikai ismeretekre, éppen ezért lehet különösen veszélyes. Egy középkategóriás számítógép segítségével akár már egy hétvége alatt remek minőségű manipulált videókat készíthetünk, a háttérmunkát a mélytanuláson alapuló mesterséges intelligencia, egy neurális háló végzi.

Ahhoz, hogy hihető hamisítvány készüljön, több ezer fotóra van szükség egy adott személyről – a rendszer ezután elkezd dolgozni, és amíg eleinte pixeles, elmosódott felvételeket fogunk látni, minél több időt és forrást biztosítunk a rendszernek, annál élethűbbé válik a másolat.

A Samsung egyes hírek szerint azonban már készített olyan automatizált deepfaket is, amelynek megalkotásához mindössze egyetlen képet használtak fel. Valós képi és hangzó anyag felhasználásával a neurális hálózat olyan videószekvenciák létrehozására is képes, amelyek alkalmasak lehetnek az emberek megtévesztésére.

Szexista robotok

A technológiával foglalkozó szakértők szerint a deepfake-ekre a dezinformáció újabb hullámaként kell tekinteni, de ennél tovább mennek: a nemek közötti harc egyik nagy fegyvereként is. A deepfake-eket ugyanis legtöbb esetben úgynevezett bosszúpornó készítésére is használják, amelynek áldozatai túlnyomó részben nők. A Qubit a Sensity felmérésére alapozva korábban azt írta, havonta nagyjából ezer deepfake videót töltenek fel a legnézettebb pornóoldalakra, amelyek szabályzata ugyan tiltja a hozzájárulás nélkül készült felvételek feltöltését, de a deepfake-kel nem nagyon tudnak mit kezdeni.

A tavaly robbant ki a Telegram-botrány is, amelyben 104 852 nő fotóját töltötték fel a Telegram üzenetküldő szolgáltatáson garázdálkodó botnak, majd a képekből algoritmusokkal manipulált aktfotókat gyártottak. A szerkesztett képeket különféle Telegram-csatornákon terjesztették, sőt még árulták is. Az esettanulmányban megvizsgált csatornák összesen több mint 100 ezer tagot számláltak, a felhasználók 70 százaléka Oroszországból vagy más kelet-európai országból származott.

Gyorsan fejlődő technológia

A Sensity deepfake-detektáló oldal szerint félévente duplájára nő az interneten keringő hamis felvételek száma.

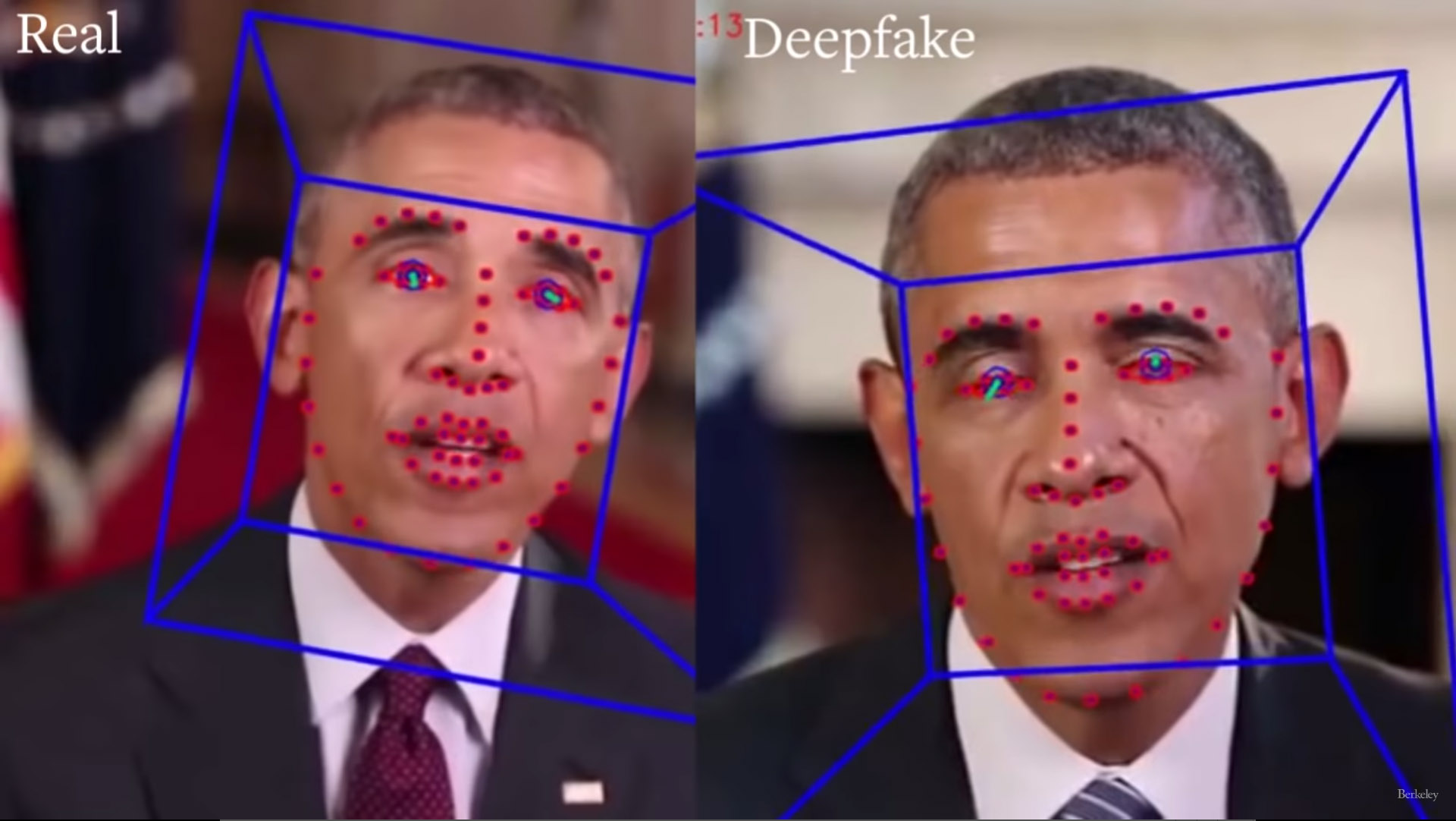

Hany Farid, a Berkley kutatója és deepfake-szakértője egy 2020-as interjújában elárulta, hogy amíg 2019 januárjában nagyon pixeles, rossz hasonulású arcképeket tudtak csak készíteni, 9 hónappal később már csaknem teljesen élethű volt egy-egy felvétel. A deepfake-ek fejlettsége napjainkban még nem közelíti meg ugyan azt a szintet, hogy a szakértőket is átverjék, a fejlődés mégis megkérdőjelezhetetlen. Ezzel azonban együtt jár a fejlett technológiát felismerni, detektálni képes szoftverek fejlesztése is – ami az állami és az üzleti szektorban is folyamatosan zajlik.

Krekó Péter, a Political Capital igazgatója lapunknak úgy fogalmazott: ahogy a technológia fejlődik, úgy fogja beérni az a módszer is, ami képes detektálni a manipulált felvételeket. „Ez rabló-pandúr szituációt fog előidézni, amelyben a rabló mindig egy kicsit előrébb jár majd” – mondta. Az elemző szerint azonban a technikára nem csak mumusként kell tekinteni, ugyanis annak fejlődése a dezinformáció elleni küzdelemben is fontos segítséget nyújthat.

Újabb lökést kaphat a dezinformációs hullám a politikában

A deepfake ugyan valóban nem tölt még be olyan jelentős szerepet a választási kampányokban és a nagypolitikában, mint azt korábban jósolták, így is okozott már zavart a világban. A gaboni elnök népszerűségét egy deepfake videóval próbálták meg csökkenteni, hogy az később bizalmatlanságig, majd egy katonai állampuccsig vezessen. Ezt azonban megakadályozták. Indiában pedig egy képviselőjelölt próbálta megszólítani a legszélesebb szavazóréteget úgy, hogy deepfake videók gyártásába kezdett – különböző nyelveken (amelyeken egyébként nem beszél) kommunikált a választókhoz.

A technológia arra is képes, hogy nem létező emberekhez generáljon arcképeket, ami a közösségi médiában megtévesztően hathat a felhasználókra. Az amerikai kongresszusban még a 2020-as választások előtt felvetődött ennek kérdése, Laurie A. Harris elemző arra hívta fel a figyelmet, hogy miután Oroszország bizonyítottan beavatkozott a 2016-os választásokba, számolni kell azzal, hogy a közösségi médiában nem létező emberek képével ellátott profilok okozhatnak veszélyt a nemzetbiztonságra, radikalizálhatják a fiatalokat.

Egyelőre a hírességek, a politikusok és a közszereplők számítanak leginkább veszélyeztetettnek a technológia miatt, ugyanis a közszereplőkről megannyi fotó, videó található meg az interneten. Az alábbi videón Jordan Peele amerikai humorista, rendező Barack Obama korábbi amerikai elnök szájába adott olyan mondatokat, ami a politikus száját sosem hagyta el - tette mindezt edukációs céllal:

A deepfake mellett már megjelent az úgynevezett shallowfake is, amely leginkább a felvétel ritmusát tudja megváltoztatni. Ennek esett áldozatául Nancy Pelosi amerikai házelnök is, akinél egy mozdulatot gyorsítottak fel, amelynek hatására úgy tűnt, mintha inzultálná egy képviselőtársát.

Veszelszki Ágnes, a Budapesti Corvinus Egyetem Kommunikáció- és Médiatudomány Tanszékén 2020-ban megalakult CGI-Deepfake kutatócsoportjának vezetője legújabb tanulmányában arról számolt be: a technika már rendelkezésre áll ahhoz, hogy bármely politikai szereplő megpróbálja deepfake-kel hitelteleníteni, lejáratni az ellenfelét – vagy a saját érdekében politikai botrányt robbantson ki. Ez pedig kihathat a demokratikus intézmények működésére és a különböző politikai aktorok hatalmára is. Felidézte Dobber és kutatótársai 2020-as felmérését is, amelyben egy, a politikai attitűdök deepfake-kel történő megváltoztatására irányuló online kísérlet nyomán azt a konzekvenciát vonták le, hogy az általuk létrehozott deepfake-videó képes volt egy politikai szereplő megítélését megváltoztatni.

A 278 vizsgálati alany válaszai alapján közölt felmérés szerint a politikus kedveltsége szignifikánsan csökkent az őt lejárató, hamis videók megnézése után – ám a politikus pártja iránti elkötelezettség változatlan maradt.

Egy kutatás szerint a politikai fake news csak az állampolgárok kisebb csoportjához jut el, míg egy másik úgy találta: csak az egyébként is polarizált, szélsőséges politikai viselkedést mutató választókat befolyásolták a 2016-as amerikai elnökválasztást manipuláló orosz trollüzenetek.

A jogalkotás malmai lassan őrölnek

A fenyegetések ellenére még nem léptek fel érdemben a deepfake terjedése ellen, leszámítva az Amerikai Egyesült Államokat, ahol tagállami szinten már most korlátozzák, állami szinten pedig kidolgozás alatt van az erről szóló javaslat. Virginia állam volt az első, ahol törvény bünteti a beleegyezés nélküli deepfake pornó készítését. Texasban és Kaliforniában pedig a politikai tartalmú deepfake-ek ügyében hoztak szigorításokat: amíg az előbbi államban a választások befolyására szolgáló hamis videókat tiltották be, addig Kaliforniában arról hoztak döntést, hogy a deepfake videók – akár politikai, akár pornográf – áldozatai kártérítést követelhetnek.

Arról, hogy az Európai Unióban és Magyarországon mikor várható valamilyen lépés erre a problémára, egyelőre nem tudni. Kérdéseinkkel felkerestük a témában illetékes Igazságügyi Minisztériumot, azonban cikkünk megjelenésééig válasz nem érkezett.

Krekó Péter, a Political Capital dezinformációs szakértője szerint nem lehet kizárni azt sem, hogy egy Facebook-botrányhoz hasonló kaliberű skandallum kell a jogi szabályozás eléréséhez, valamint megjegyezte: itthon egyelőre még nem kapcsolódott be a politikai kampányokba ez a technológia. „Igaz, a lehetőség adott, és valószínűleg nem is kell nagyon sokat várni rá” – mondta.

Hogyan küzdhetünk ellene?

A CNN nemrég átfogó riportot készített a Pentagonban, ahol az amerikai nemzetbiztonság már készül az újfajta dezinformációs hullámra. Az Egyesült Államok Védelmi Minisztériumának kutatásokért felelős részlege jelenleg több deepfake-technológiával kapcsolatos kutatást is támogat, sok millió dollár értékben. A kutatás célja, hogy a mesterséges intelligencia által készített felvételeket leleplezzék: ehhez egy olyan algoritmus kifejlesztésén dolgoznak, amely képes kiszűrni a más algoritmusok által készített felvételeket, hangfájlokat.

A vezető techcégek is felfigyeltek a deepfake-ek elleni védekezés aranybányájára, a Facebook és a Microsoft is a technológia detektálására alkalmas program fejlesztésébe kezdett. A Facebook 2019 szeptemberében versenyt is szervezett, hogy megtalálja a leghatékonyabb algoritmust a deepfake-ek ellen, a győztes versenyző szoftvere 82 százalékos pontossággal szúrta ki, melyik a hamis és melyik a manipulálatlan videó. A Microsoft pedig tavaly szeptemberben jelentette be, hogy felveszi a harcot az álhírterjesztéssel, és belekezd a Video Authenticator program fejlesztésébe.

Ameddig azonban nem elérhető a lakosság számára a hamisított felvételeket detektáló szoftver, addig csakis saját ítélőképességünkben bízhatnak. Érdemes azonban alaposan utána nézni annak, milyen forrásból származik az információ, és amennyiben lehetetlen állításokat fogalmaznak meg egy-egy felvételen, érdemes több forrásból is meggyőződni annak igazságtartalmáról. A kamuvideókon a szájmozgás helyessége mellett a szemek mozgását is érdemes megfigyelni – szakértők és filmes szakemberek szerint ugyanis ezeket a legnehezebb valósághűen manipulálni.

(Kiemelt kép: Youtube | UC Berkeley)